Pelajari cara kerja TabPFN yang menggunakan in-context learning untuk data tabular. Bandingkan performanya dengan Random Forest dan CatBoost dalam eksperimen praktis.

Kalau kamu kerja dengan data tabular—ya, data yang bentuknya tabel dengan baris dan kolom—kamu pasti familiar sama Random Forest, XGBoost, atau CatBoost.

Model-model berbasis decision tree ini udah jadi andalan bertahun-tahun karena kuat, fleksibel, dan nggak butuh preprocessing rumit.

Tapi sekarang ada pendekatan baru yang menarik perhatian: TabPFN.

TabPFN ini beda banget cara kerjanya. Nggak seperti model tradisional yang training dari nol tiap kali dapat dataset baru, TabPFN itu udah pretrained dulu.

Model ini belajar dari jutaan dataset sintetis yang dibuat dari proses kausal. Jadi waktu kamu kasih data, dia nggak training—langsung prediksi aja pakai apa yang udah dipelajari sebelumnya.

Konsepnya mirip in-context learning yang dipakai large language model kayak GPT. Versi terbarunya, TabPFN-2.5, bisa handle dataset yang lebih besar dan kompleks.

Penelitian nunjukkin TabPFN-2.5 bisa ngalahin XGBoost dan CatBoost yang udah dituning, bahkan nyaris selevel sama AutoGluon.

Yang menarik, TabPFN juga punya fitur distillation. Prediksinya bisa dikonversi jadi model neural network atau tree ensemble yang lebih kecil, jadi inference-nya jauh lebih cepat.

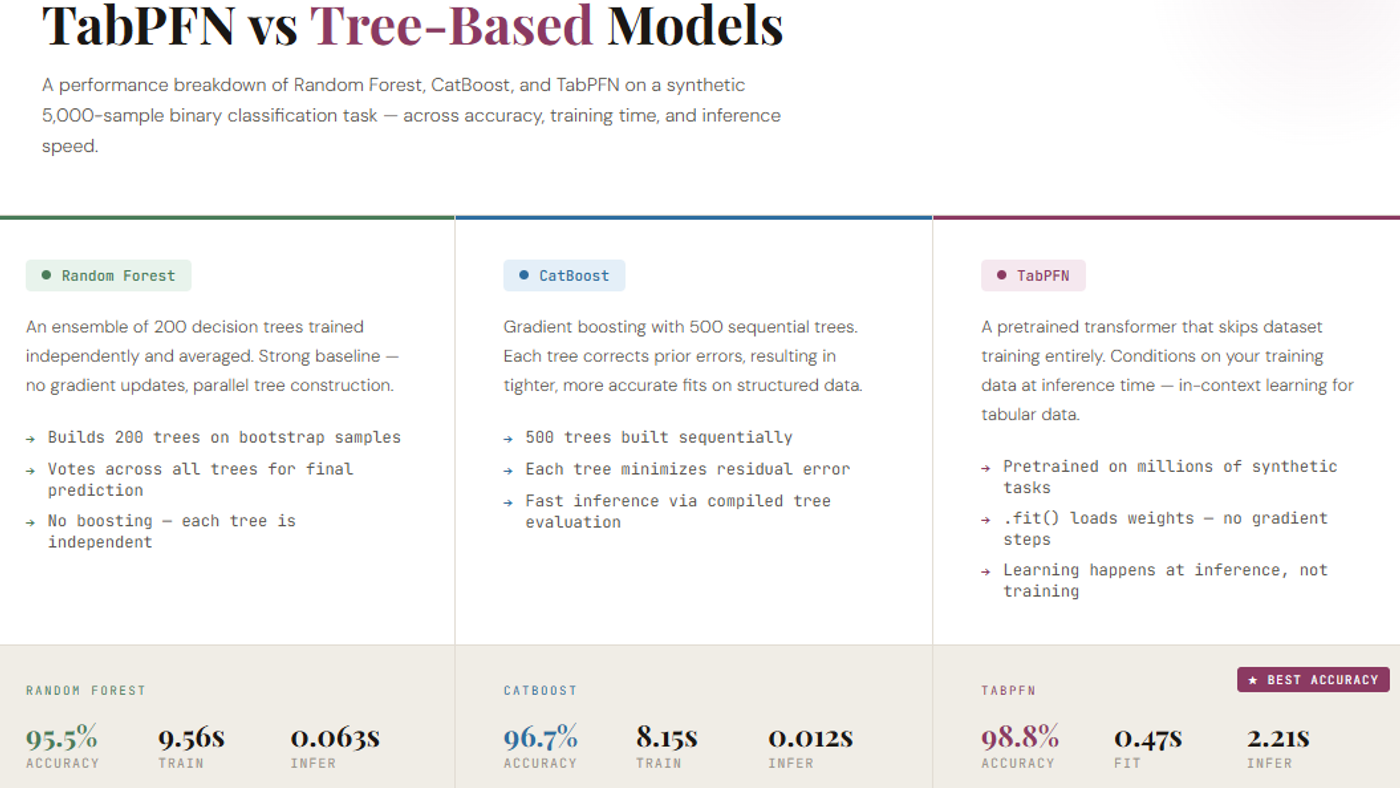

Buat buktiin sendiri, kita coba bandingin tiga model: Random Forest, CatBoost, dan TabPFN. Dataset yang dipakai sintetis: 5.000 sample, 20 fitur, dengan 10 fitur informatif dan 5 yang redundan.

Random Forest dengan 200 trees dapet akurasi 95.5%. Training-nya butuh waktu 9.56 detik, inference cuma 0.06 detik. Hasil yang solid buat baseline.

CatBoost lebih oke: akurasi 96.7%, training 8.15 detik, dan inference super cepat cuma 0.01 detik. Memang gradient boosting lebih powerful buat data tabular.

Nah, TabPFN? Akurasinya paling tinggi: 98.8%. Fit time-nya cuma 0.47 detik karena memang nggak ada training—cuma load pretrained weights.

Tapi ada trade-off-nya. Inference TabPFN butuh 2.21 detik, jauh lebih lambat dari dua model lainnya. Kenapa? Karena dia proses training data dan test data bareng pas prediksi.

Jadi in-context learning-nya itu terjadi di inference, bukan di training phase.

Dari hasil ini, TabPFN cocok banget buat eksperimen cepat, prototyping, atau dataset small-to-medium dimana kamu pengen hasil bagus tanpa ribet tuning hyperparameter.

Buat production yang butuh low latency, CatBoost masih unggul. Atau kamu bisa pakai distillation engine-nya TabPFN buat kompres model jadi lebih ringan.

Intinya, TabPFN bawa shift mindset: trading traditional training effort dengan inference-driven approach yang lebih fleksibel.

Practical takeaway-nya: coba TabPFN di project tabular kamu yang berikutnya, terutama kalau kamu males tuning parameter atau butuh hasil cepat. Kalau latency kritis, pertimbangkan distillation atau tetap pakai CatBoost.

AI Updates lagi bergerak cepat, jadi jangan cuma lihat headline.

MarkTechPost

Catatan redaksi

Kalau lo cuma ambil satu hal dari artikel ini

AI Updates update dari MarkTechPost.

Sumber asli

Artikel ini merupakan rewrite editorial dari laporan MarkTechPost.

Baca artikel asli di MarkTechPost→

![A Report on Burnout in Open Source Software Communities (2025) [pdf]](https://cdn.sanity.io/images/dc330kkz/production/5abef2280c91c15bf2815dd8fd0ec564c6d1c72d-1024x576.jpg?w=1400&h=788&fit=crop&auto=format&q=82)