Pelajari cara PageIndex menggantikan vector similarity dengan tree-based reasoning untuk retrieval yang lebih akurat dalam sistem RAG.

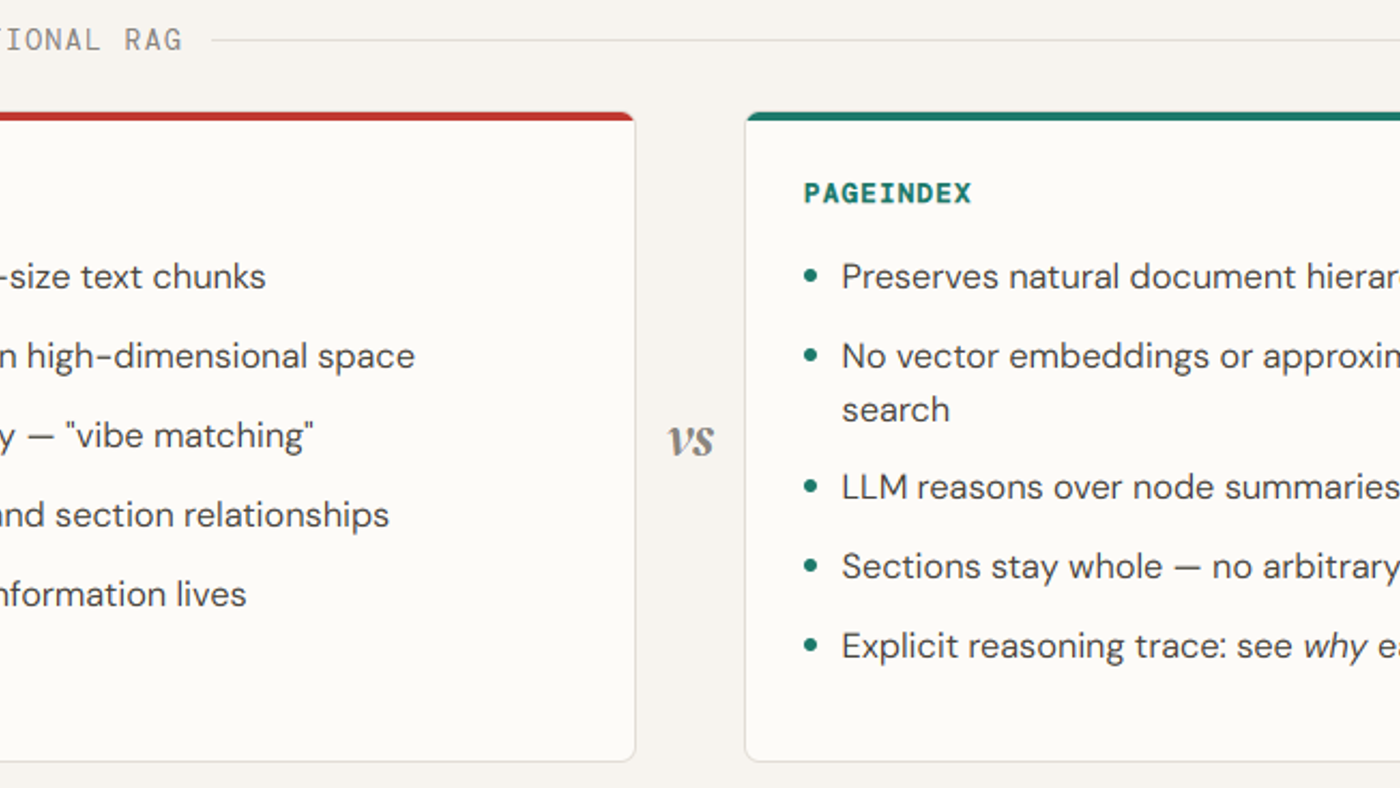

Retrieval adalah bagian paling rapuh dalam sistem RAG. Kebanyakan pipeline tradisional pakai vector similarity—mengubah query dan chunk dokumen jadi embedding, lalu ambil yang "paling dekat". Tapi similarity itu lemah sebagai pengganti relevance yang sebenarnya kita butuhkan: relevance yang didasarkan pada reasoning.

Dalam dokumen panjang dan profesional—kayak laporan keuangan, paper riset, atau teks hukum—jawaban yang benar sering nggak ada di paragraf yang paling mirip secara semantik. Butuh navigasi struktur, pemahaman konteks, dan reasoning multi-langkah antar bagian. Di sinilah vector-based RAG mulai jebol.

PageIndex hadir buat nutup gap ini dengan memikirkan ulang retrieval dari nol. Alih-alih chunking dokumen dan search pakai embedding, dia bangun tree index berbasis table-of-contents dan pakai LLM buat reasoning atas struktur itu—mirip kayak ahli manusia yang scan bagian, drill down, dan hubungin ide-ide.

Proses retrieval tanpa vector dan berbasis reasoning ini lebih interpretable, traceable, dan sesuai dengan cara pengetahuan diekstrak dari dokumen kompleks. Dengan ganti similarity search jadi structured exploration dan tree-based reasoning, PageIndex kasih retrieval accuracy yang jauh lebih tinggi—dibuktikan lewat performa kuat di benchmark kayak FinanceBench.

Di artikel ini, kita bakal pakai PageIndex buat index paper Transformer yang legendaris—"Attention Is All You Need"—dan jalankan dua query cross-cutting tanpa satu pun vector atau embedding. Alih-alih chunking PDF dan retrieve by similarity, PageIndex bangun hierarchical tree dari section-section dokumen, lalu pakai GPT-5.4 buat reasoning atas node summaries dan identifikasi section mana yang punya jawaban—sebelum baca satu kata full text pun.

Buat setup, kamu butuh PageIndex API key dan OpenAI API key. Install dependencies dengan pip: pageindex, openai, dan requests. Import PageIndexClient dan konfigurasi dengan API key. Terus import juga OpenAI client dan bikin async helper function buat kirim prompt ke model.

Langkah pertama: download paper Transformer langsung dari arXiv dan submit ke PageIndex. Dia bakal proses PDF dan bangun hierarchical tree dari section-section—tiap node nyimpen title, summary, dan full section text. Setelah tree siap, print buat inspect struktur yang diinfer: tiap chapter, subsection, dan nested heading jadi node, preserve organisasi natural dokumen persis kayak yang authors maksud.

Dengan tree yang udah jadi, kita jalankan query yang sengaja cross-cutting—yang nggak bisa dijawab oleh satu section aja. Kita strip full text dari tiap node, tinggalin title dan summaries, dan pass seluruh struktur tree ke GPT-5.4. Model kemudian reasoning atas summaries ini buat identifikasi tiap node yang kemungkinan punya jawaban relevan, return thinking step-by-step dan list matched node IDs.

Ini inti yang bikin PageIndex beda: LLM yang decide mau lihat mana sebelum full text diload. Setelah node relevan diidentifikasi, pull full text mereka dan stitch jadi satu context block—tiap section dilabel jelas supaya model tahu sumber informasi. Context gabungan ini diteruskan ke GPT-5.4 dengan prompt terstruktur yang minta core motivation, specific complexity numbers, dan caveats yang authors akui.

Model jawab pakai hanya apa yang di-retrieve, ground tiap claim langsung di teks paper. Buat nunjukin tree dibangun sekali dan dipakai ulang tanpa biaya tambahan, kita jalankan query kedua—kali ini target localized mechanism daripada cross-cutting design decision. Tree structure yang sama dipass ke GPT-5.4, yang narrow search ke attention subsections, retrieve full text mereka, dan generate penjelasan clean tentang cara kerja multi-head attention dan kenapa scaling factor penting.

Nggak ada re-indexing, nggak ada re-embedding—cuma pertanyaan baru atas tree yang sama.

Takeaway praktis: Kalau kamu kerja dengan dokumen kompleks yang butuh precision tinggi—finance, legal, research—pertimbangkan pendekatan reasoning-based kayak PageIndex daripada blind vector similarity. Bangun struktur hierarkis sekali, lalu tanya berulang kali dengan cost retrieval yang minimal. Interpretability juga lebih baik karena kamu bisa trace exactly kenapa LLM pilih section tertentu.

AI Updates lagi bergerak cepat, jadi jangan cuma lihat headline.

MarkTechPost

Catatan redaksi

Kalau lo cuma ambil satu hal dari artikel ini

AI Updates update dari MarkTechPost.

Sumber asli

Artikel ini merupakan rewrite editorial dari laporan MarkTechPost.

Baca artikel asli di MarkTechPost→

![A Report on Burnout in Open Source Software Communities (2025) [pdf]](https://cdn.sanity.io/images/dc330kkz/production/5abef2280c91c15bf2815dd8fd0ec564c6d1c72d-1024x576.jpg?w=1400&h=788&fit=crop&auto=format&q=82)