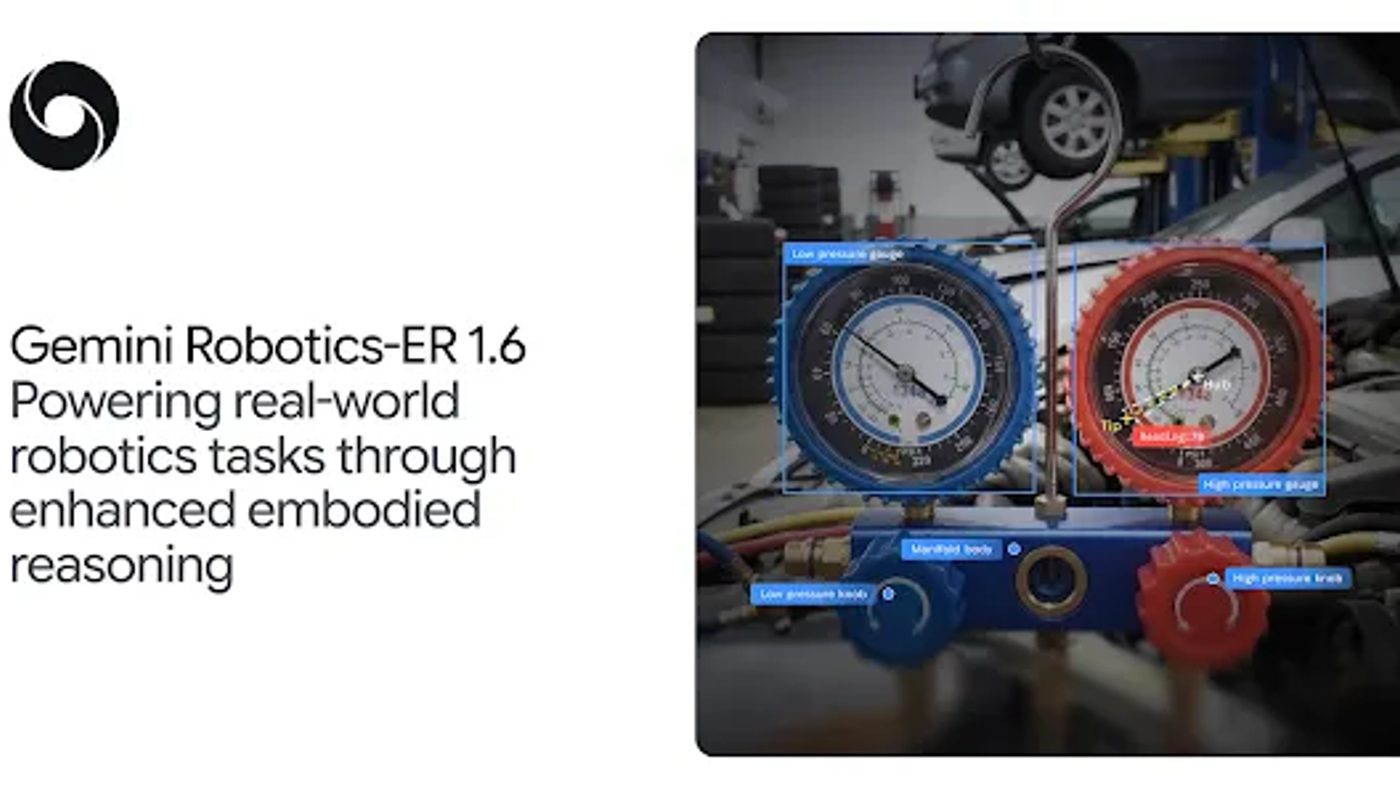

Gemini Robotics-ER 1.6 dari DeepMind meningkatkan kemampuan robot dalam memahami ruang dan sudut pandang berbeda. Pelajari bagaimana embodied reasoning bikin robot lebih canggih.

Google DeepMind baru aja ngumumin update terbaru buat dunia robotika. Namanya Gemini Robotics-ER 1.6, dan ini bukan sekadar upgrade biasa.

Model ini fokus ke dua hal penting: spatial reasoning dan multi-view understanding. Intinya, robot jadi lebih paham di mana dia berada dan gimana lingkungan sekitarnya tersusun.

Bayangin kamu lagi di ruangan baru. Mata kamu langsung nangkep posisi meja, kursi, pintu, semuanya dalam 3D. Nah, itu yang dilatih ke robot ini.

Spatial reasoning itu kemampuan buat memahami hubungan antar objek dalam ruang. Robot harus tahu: kalau bola di depan kursi, berarti kursi ada di belakang bola. Kedengarannya simpel, tapi susah buat mesin.

Multi-view understanding bikin robot bisa nyambungin informasi dari berbagai sudut pandang. Kamera di kepala robot beda hasilnya sama kamera di tangan. Model ini belajar nyatukan semuanya jadi satu gambaran utuh.

Kenapa ini penting? Robot di dunia nyata gak bisa cuma lihat dari satu angle. Dia harus gerak, lihat dari sisi lain, terus tetap ingat posisi semua benda.

Gemini Robotics-ER 1.6 pake arsitektur vision-language model yang udah familiar. Bedanya, sekarang ditambahin kemampuan embodied reasoning. Jadi model gak cuma ngerti gambar dan teks, tapi juga hubungan fisik antar benda.

Embodied reasoning ini konsep penting di AI modern. Robot harus paham bahwa dia punya badan fisik yang bisa berinteraksi sama dunia. Bukan cuma observer, tapi aktor yang bisa ngaruh ke lingkungan.

Salah satu tantangan besar di robotika autonomous adalah generalisasi. Robot yang dilatih di satu ruangan sering gagal di ruangan lain. Dengan spatial reasoning yang lebih kuat, harapannya robot bisa lebih adaptif.

Model ini juga dibangun dengan mempertimbangkan efisiensi komputasi. Robot gak bisa bawa server raksasa di punggungnya. Gemini Robotics-ER 1.6 dirancang buat jalan di hardware yang realistis buat robot mobile.

Praktisnya, ini berarti robot bisa lebih mandiri di berbagai situasi. Dari gudang yang berantakan sampai rumah dengan furnitur yang berubah-ubah posisi.

Buat kamu yang ngikutin perkembangan AI, ini langkah signifikan. Dari chatbot yang cuma ngobrol, sekarang AI mulai punya

badan

buat eksplorasi dunia fisik.

Takeaway praktis: Kalau kamu developer atau researcher di bidang robotika, pertimbangkan gimana spatial reasoning bisa ningkatin robustness sistem kamu. Jangan cuma fokus ke task-specific training, tapi juga kemampuan umum buat memahami ruang.

Buat yang penasaran teknisnya, model ini ngembangin pendekatan end-to-end learning. Data dari berbagai sensor langsung diproses jadi aksi, tanpa banyak hand-engineered rules.

Masa depan robotika autonomous makin dekat. Dengan model seperti Gemini Robotics-ER 1.6, robot gak cuma bisa lihat, tapi bener-bener mengerti ruang tempat dia berada.

AI Updates lagi bergerak cepat, jadi jangan cuma lihat headline.

DeepMind Blog

Catatan redaksi

Kalau lo cuma ambil satu hal dari artikel ini

AI Updates update dari DeepMind Blog.

Sumber asli

Artikel ini merupakan rewrite editorial dari laporan DeepMind Blog.

Baca artikel asli di DeepMind Blog→

![A Report on Burnout in Open Source Software Communities (2025) [pdf]](https://cdn.sanity.io/images/dc330kkz/production/5abef2280c91c15bf2815dd8fd0ec564c6d1c72d-1024x576.jpg?w=1400&h=788&fit=crop&auto=format&q=82)